京东评论情感分析:开源项目经验分享

京东评论情感分析系统:开源项目经验分享

一、项目背景

在电子商务飞速发展的今天,用户评论已经成为消费者决策的重要参考依据,同时也是商家了解产品优劣、改进服务的宝贵数据源。京东作为中国最大的综合电商平台之一,每天产生海量的用户评论数据。如何高效、准确地分析这些非结构化文本数据,提取有价值的情感信息,成为电商领域的重要研究课题。

情感分析(Sentiment Analysis)是自然语言处理(NLP)中的一个重要分支,旨在通过计算机技术自动识别和提取文本中的情感倾向、观点和态度。在电商场景中,情感分析可以帮助:

- 商家快速了解产品的优缺点,及时调整经营策略

- 平台监测用户满意度,优化服务质量

- 消费者通过情感趋势判断产品的真实口碑

本项目正是基于这一背景,构建了一个针对京东评论的情感分析系统,通过比较多种机器学习算法的性能,为电商情感分析提供参考和解决方案。

二、项目核心信息

2.1 项目概述

京东评论情感分析系统是一个基于Python的开源项目,采用多模型对比的方法对京东商品评论进行情感分类。项目支持四种主流机器学习算法:

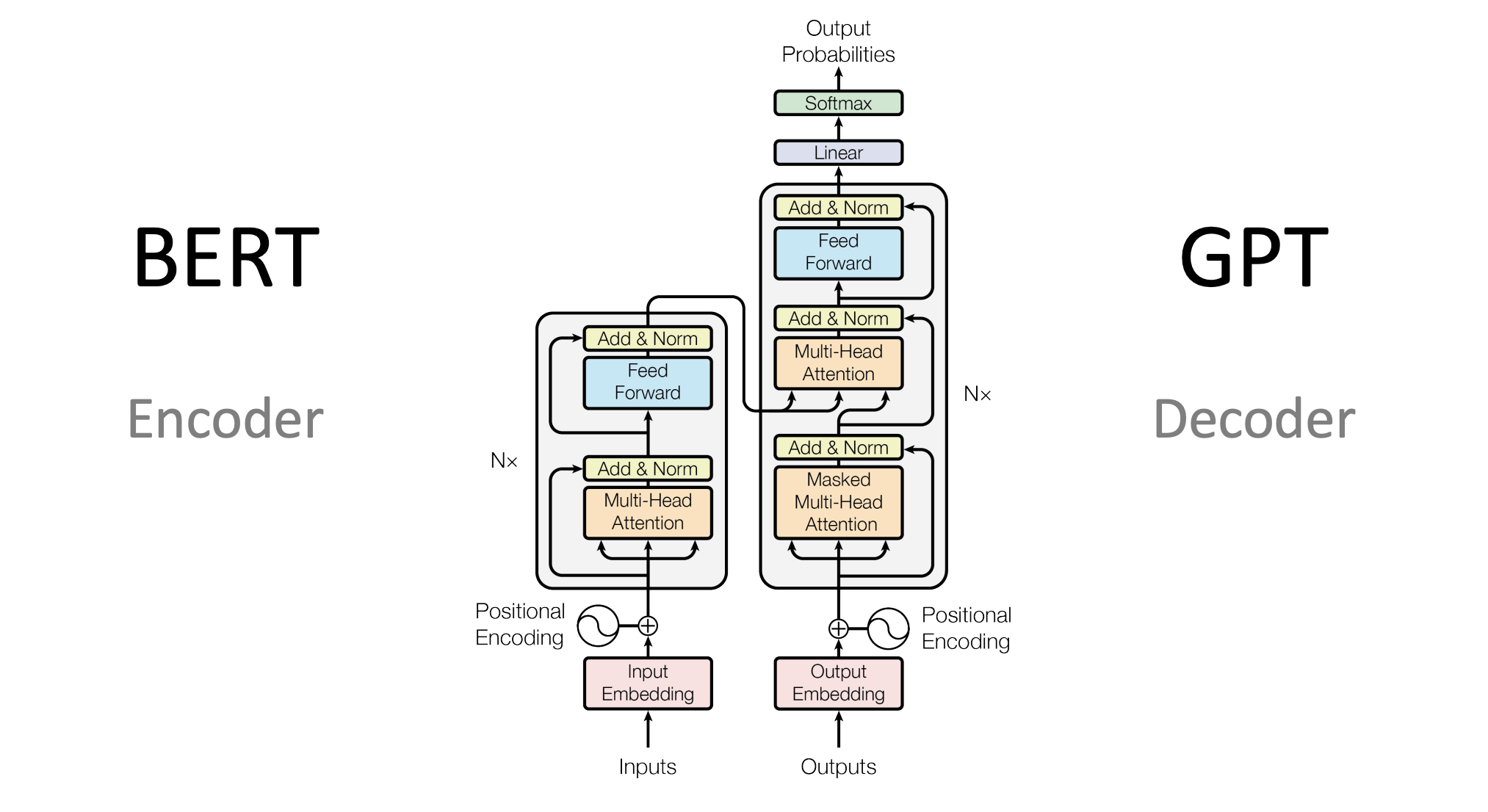

- BERT(Bidirectional Encoder Representations from Transformers):基于Transformer的预训练语言模型

- LSTM+Attention(长短时记忆网络+注意力机制):结合循环神经网络与注意力机制

- 朴素贝叶斯(Naive Bayes):经典概率模型

- 支持向量机(SVM):传统机器学习算法

2.2 技术栈

项目采用以下主要技术和框架:

- 深度学习框架:PyTorch 1.9+,Transformers(Hugging Face)

- 机器学习库:scikit-learn,numpy,pandas

- 中文处理:jieba(中文分词)

- 数据可视化:matplotlib,seaborn

2.3 数据集

项目使用京东商品评论数据集

数据格式为CSV,包含两个字段:

sentence:评论文本内容label:情感标签(0=负面,1=正面)

2.4 模型性能对比

经过实验测试,各模型在京东评论数据集上的性能表现如下:

| 模型 | 准确率 | F1分数 | 训练时间 | 特点 |

|---|---|---|---|---|

| BERT | ~90% | ~90% | 约5小时 | 性能最佳,计算资源需求高 |

| LSTM+Attention | ~86% | ~86% | 约3小时 | 深度学习模型,需要GPU |

| 朴素贝叶斯 | ~86% | ~86% | ~5秒 | 训练速度快,简单高效 |

| SVM | ~86% | ~86% | ~6秒 | 传统机器学习,稳定可靠 |

从表中可以看出:

- BERT模型在准确率和F1分数上明显优于其他模型,达到90%的水平,但训练时间长,需要大量计算资源

- LSTM+Attention模型性能略低于BERT,与传统机器学习模型接近

- 朴素贝叶斯和SVM在性能上表现相当,但训练速度更快,适合快速迭代场景

三、项目功能与应用场景

3.1 核心功能

-

数据预处理:

- 中文分词(基于jieba)

- 文本清洗(去除特殊字符、表情符号等)

- 数据格式转换

-

模型训练:

- 统一的训练接口,支持四种算法

- 自动保存训练好的模型

- 交叉验证支持

-

模型评估:

- 多指标评估

- 混淆矩阵生成

- 可视化报告

-

情感分析:

- 单条评论情感判断

- 批量评论处理

- 情感趋势分析

3.2 应用场景

-

电商平台情感监测:

- 实时监测商品评论情感趋势

- 自动识别负面评论,及时处理客户投诉

- 分析产品优缺点,为商家提供改进建议

-

品牌口碑管理:

- 监测竞争对手产品的用户反馈

- 分析品牌形象变化趋势

- 预警负面舆情

-

个性化推荐:

- 结合用户历史评论情感,提供更精准的推荐

- 识别用户情感偏好,优化推荐算法

-

市场研究:

- 分析不同产品类别的用户情感分布

- 研究价格、促销活动对用户情感的影响

- 预测产品销售趋势

3.3 使用示例

# 加载数据

from data.data_loader import DataLoader

loader = DataLoader()

data = loader.load_jd_reviews()

# 训练SVM模型(最快)

from models.svm_model.train_svm import train_svm

model = train_svm(data['train'])

# 评估模型

from models.svm_model.evaluate_svm import evaluate_svm

results = evaluate_svm(model, data['test'])

# 情感分析

sentence = "商品质量很好,物流也很快,非常满意!"

prediction = model.predict([sentence]) # 输出:1(正面)

四、项目创新点

4.1 多模型对比框架

本项目的最大特色在于提供了一个统一的多模型对比框架,使得研究人员和开发者可以方便地比较不同算法在相同数据集上的表现。这种设计带来以下优势:

- 公平比较:所有模型使用相同的数据预处理流程和评估指标

- 易于扩展:新增模型只需实现统一接口即可集成

- 性能权衡:帮助用户根据实际需求选择最合适的模型

4.2 注意力机制的创新应用

在LSTM模型中,项目创新性地集成了注意力机制(Attention Mechanism),这在中文情感分析中具有重要意义:

# 注意力机制实现(来自utils/attention.py)

class Attention(nn.Module):

def __init__(self, hidden_dim):

super(Attention, self).__init__()

self.attention = nn.Sequential(

nn.Linear(hidden_dim, hidden_dim),

nn.Tanh(),

nn.Linear(hidden_dim, 1, bias=False)

)

def forward(self, rnn_outputs):

# rnn_outputs: [batch_size, seq_len, hidden_dim]

attention_weights = torch.softmax(

self.attention(rnn_outputs).squeeze(2),

dim=1

)

# [batch_size, 1, seq_len] * [batch_size, seq_len, hidden_dim]

context_vector = torch.bmm(

attention_weights.unsqueeze(1),

rnn_outputs

).squeeze(1)

return context_vector, attention_weights

注意力机制的优势:

- 自动学习文本中最重要的词汇

- 处理长文本时更有效

- 提供可解释性(可视化注意力权重)

4.3 综合可视化系统

项目提供了丰富的可视化功能,帮助用户直观理解模型性能和数据特征:

-

模型性能对比:

- 准确率、F1分数雷达图

- 训练时间对比柱状图

- ROC曲线

-

错误分析:

- 混淆矩阵热力图

- 错误分类样本展示

- 模型偏差分析

-

注意力可视化:

- 显示模型关注的关键词

- 句子级注意力权重分布

- 词汇重要性排名

五、技术实现细节

5.1 数据预处理流程

# 数据预处理核心代码(来自data/preprocess.py)

def preprocess_text(text):

# 1. 去除特殊字符

text = re.sub(r'[^\w\s]', '', text)

# 2. 中文分词

words = jieba.cut(text)

# 3. 去除停用词

words = [word for word in words if word not in stopwords]

# 4. 归一化处理

return ' '.join(words)

5.2 BERT模型实现

# BERT模型训练(来自models/bert_model/train_BERT.py)

from transformers import BertTokenizer, BertForSequenceClassification

tokenizer = BertTokenizer.from_pretrained('bert-base-chinese')

model = BertForSequenceClassification.from_pretrained(

'bert-base-chinese',

num_labels=2

)

# 微调过程

optimizer = AdamW(model.parameters(), lr=2e-5)

for epoch in range(epochs):

for batch in train_loader:

inputs = tokenizer(

batch['text'],

padding=True,

truncation=True,

return_tensors='pt'

)

outputs = model(**inputs, labels=batch['label'])

loss = outputs.loss

loss.backward()

optimizer.step()

5.3 模型选择建议

| 场景 | 推荐模型 | 原因 |

|---|---|---|

| 生产环境,追求最高准确率 | BERT | 性能最佳,效果稳定 |

| 资源受限,快速部署 | 朴素贝叶斯/SVM | 训练快,内存占用低 |

| 需要可解释性 | LSTM+Attention | 可视化注意力权重 |

| 研究实验,模型比较 | 所有模型 | 综合对比各模型性能 |

六、总结

京东评论情感分析系统是一个功能完善、设计合理的开源项目,为电商领域的情感分析提供了全面的解决方案。通过比较四种主流算法的性能,项目不仅展示了深度学习在NLP任务中的优势,也证明了传统机器学习算法在特定场景下的实用价值。

项目的主要贡献包括:

- 提供了一个统一的多模型对比框架

- 实现了注意力机制与LSTM的有效结合

- 提供了丰富的可视化工具和分析报告

- 采用模块化设计,便于扩展和维护

对于希望在电商领域应用情感分析技术的开发者和研究人员,本项目是一个极佳的起点和参考。通过本项目,用户可以快速理解不同算法的特点,选择最适合自己场景的解决方案,并基于现有框架进行二次开发和定制。

未来,随着深度学习技术的不断发展,特别是大型语言模型的进步,情感分析的准确率和应用范围将进一步提升。本项目也将持续更新,集成最新的NLP技术,为电商情感分析领域的发展贡献力量。

项目地址:https://github.com/hongming351/sentiment_analysis

许可证:MIT License